Ogni novità importante, anche a bordo delle nostre auto, necessità di un certo lasso di tempo per essere compresa a fondo. Oggi, iniziamo ad abituarci a sistemi quali il cruise control adattivo o la frenata rigenerativa ma le tecnologie più recenti e complesse, nonostante non siano più un mistero, devono ancora fare breccia nel nostro modo di vivere le auto. Tra queste, la guida autonoma rappresenta uno degli step evolutivi più importanti dell’ecosistema automotive. Un cambiamento potenzialmente epocale in grado di aprire la strada alle nuove frontiere dei trasporti. Grazie a Volvo ho avuto la possibilità di approfondire questi temi attraverso un interessante talk virtuale. Tra gli argomenti toccati, ho deciso di focalizzarmi su un aspetto apparentemente distante dall’immaginario comune: l’etica. Il tema etico inizia ad avere un ruolo fondamentale anche nel settore dei trasporti e gli esperti del settore convocati da Volvo hanno fatto luce sulla questione.

Grazie a Volvo ho avuto la possibilità di approfondire questi temi attraverso un interessante talk virtuale. Tra gli argomenti toccati, ho deciso di focalizzarmi su un aspetto apparentemente distante dall’immaginario comune: l’etica. Il tema etico inizia ad avere un ruolo fondamentale anche nel settore dei trasporti e gli esperti del settore convocati da Volvo hanno fatto luce sulla questione.

Leggi anche: le auto elettriche più sicure

Guida autonoma: a che punto siamo

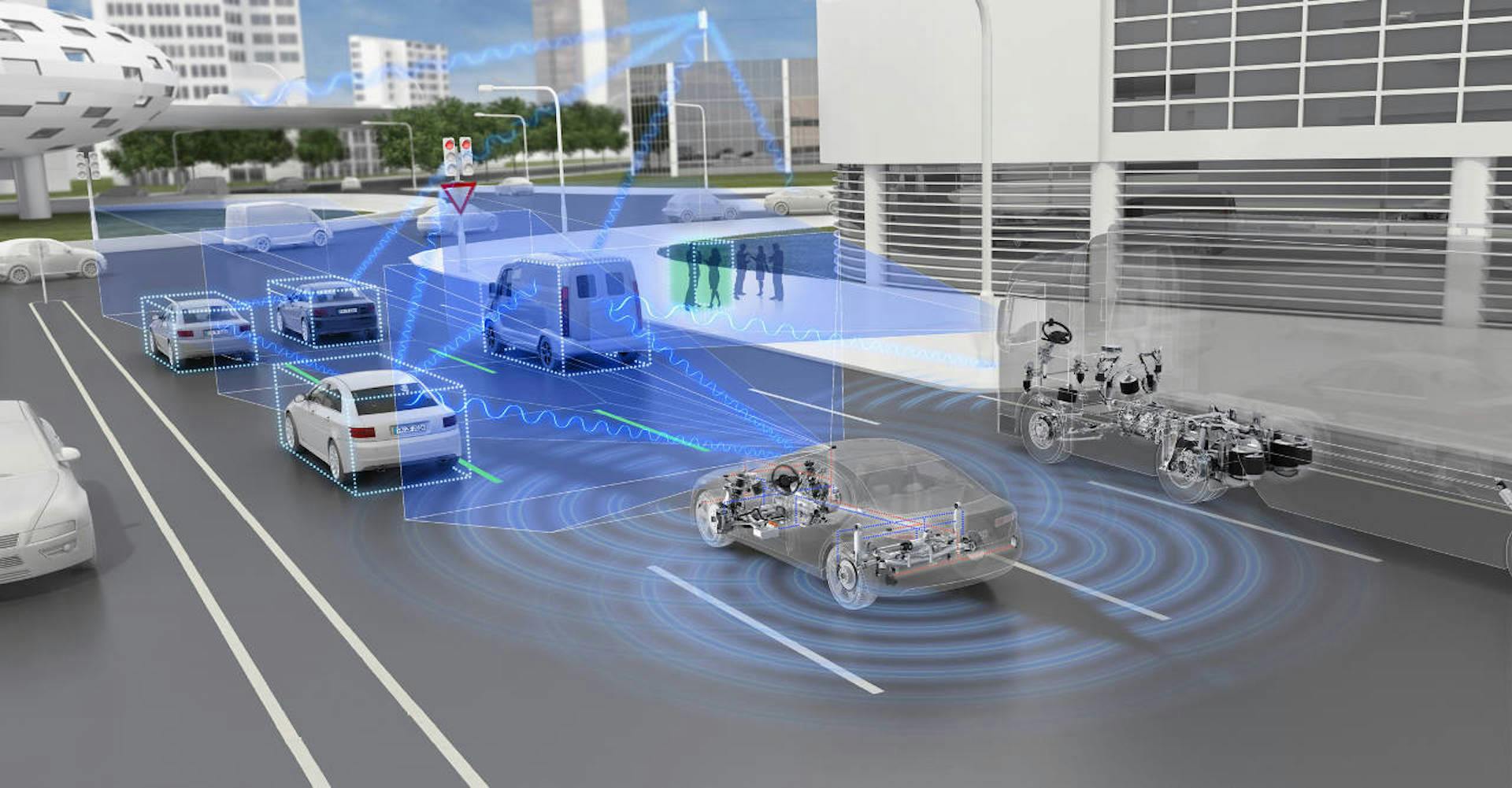

Al momento lo stato dell’arte della guida autonoma permette una completa automazione del veicolo; in altre parole il livello 5 di guida autonoma è già stato raggiunto. All’atto pratico, questa tecnologia deve ancora esprimersi completamente al di fuori di strade chiuse e circuiti di prova, luoghi dove l’imprevisto diventa prevedibile. Per questo motivo, i nuovi modelli portano su strada sistemi di guida autonoma fino al livello 2, gli unici regolamentati, in attesa delle prime autorizzazioni per la guida autonoma condizionata. Università e centri di ricerca, nel frattempo, continuano a studiare gli aspetti più avanzati di questa tecnologia spingendosi ben oltre il diritto e raggiungendo l’etica e la filosofia.

Le auto dovranno “scegliere”

Il problema di fondo è il seguente. Le auto dotate di tecnologia a guida autonoma hanno una velocità di calcolo sufficiente ad affrontare in modo strutturato situazioni in cui un conducente umano potrebbe solo reagire d’istinto. Da questo, in situazioni di pericolo – ad esempio quelle in cui è in gioco la vita delle persone – quali sono i criteri con cui un’auto dovrebbe decidere? E poi, chi è il responsabile per la scelta di questi criteri? La risposta non è banale e la nostra società rifiuta naturalmente parametri così strutturati quando sono in gioco scelte drammatiche e tragiche. È anche vero che a capacità di elaborazione elevate corrisponde una riduzione dei rischi massima. Tuttavia, il rischio zero non esiste: guasti e situazioni impreviste devono avere il giusto peso anche anche in un mondo di auto a guida autonoma. Anche perché non è escluso che nascano ulteriori fattori di rischio. Per questo motivo, da alcuni anni si discute delle implicazioni etiche legate alle auto a guida autonoma.

È anche vero che a capacità di elaborazione elevate corrisponde una riduzione dei rischi massima. Tuttavia, il rischio zero non esiste: guasti e situazioni impreviste devono avere il giusto peso anche anche in un mondo di auto a guida autonoma. Anche perché non è escluso che nascano ulteriori fattori di rischio. Per questo motivo, da alcuni anni si discute delle implicazioni etiche legate alle auto a guida autonoma.

Leggi anche: Guida autonoma di livello 3 Mercedes e Honda battono Tesla

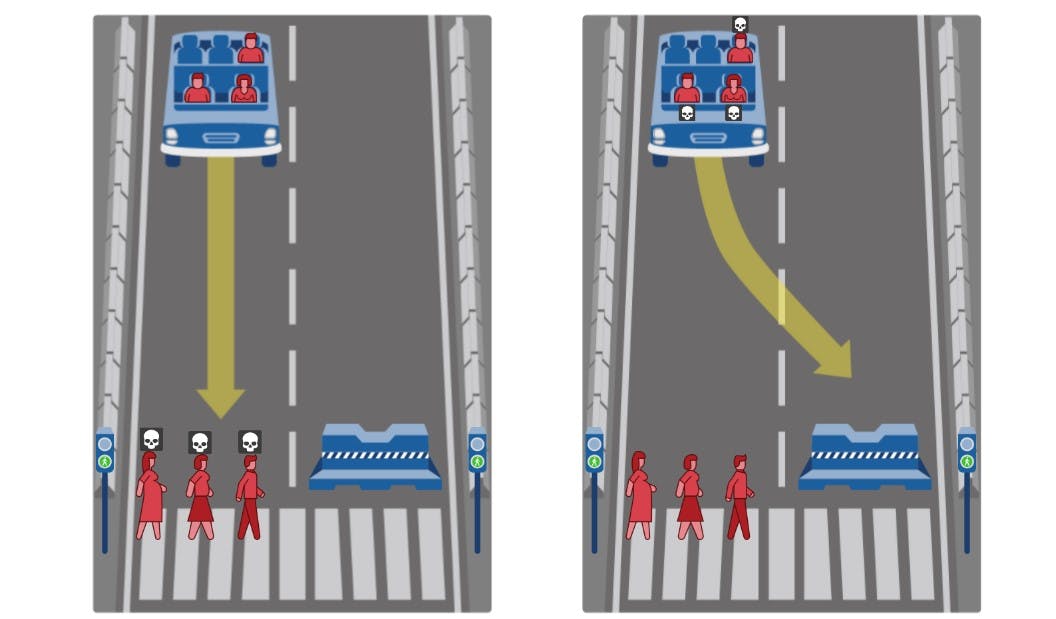

Facendo un esempio pratico: cosa succede se un’auto completamente automatizzata ha un guasto ai freni? Sicuramente la sensoristica avanzata è in grado di accorgersi del pericolo. Tuttavia, in caso di situazione al limite – e sono proprio queste condizioni a dover essere studiate per tempo – l’automobile autonoma potrebbe trovarsi di fronte a scelte drastiche che coinvolgono la vita degli occupanti e degli altri utenti delle strada. L’università del Massachusetts (MIT), assieme ad altri importanti attori della scena universitaria e di ricerca, hanno cercato di rispondere a una semplice domanda: cosa farebbe un uomo al posto della macchina?

Facendo un esempio pratico: cosa succede se un’auto completamente automatizzata ha un guasto ai freni? Sicuramente la sensoristica avanzata è in grado di accorgersi del pericolo. Tuttavia, in caso di situazione al limite – e sono proprio queste condizioni a dover essere studiate per tempo – l’automobile autonoma potrebbe trovarsi di fronte a scelte drastiche che coinvolgono la vita degli occupanti e degli altri utenti delle strada. L’università del Massachusetts (MIT), assieme ad altri importanti attori della scena universitaria e di ricerca, hanno cercato di rispondere a una semplice domanda: cosa farebbe un uomo al posto della macchina?

L’immagine sopra è un esempio di un’ipotetica situazione al limite: un’auto con tre occupanti ha un guasto completo al sistema frenante mentre alcuni pedoni stanno attraversando la strada. Come si dovrebbe comportare l’auto? Questo esperimento sociale – a cui possono partecipare tutti gli utenti del web – è disponibile attraverso la piattaforma Moral Machine sviluppata proprio dall’MIT. Gli scenari ipotizzati sono molteplici e, pur tenendo conto di numerosi parametri come il sesso, l’età, il ceto sociale o il rispetto delle norme stradali, ogni situazione è stata ridotta a due sole possibilità di scelta. Nel caso di esempio, l’auto dovrà scegliere se deviare la propria traiettoria o meno. Quando entrano in gioco componenti morali ed etiche è veramente difficile standardizzare situazioni del genere. In altre parole, la componente umana potrebbe continuare a giocare un ruolo fondamentale.

I partecipanti al talk di Volvo

Guido Calabresi, Professore Emerito nella Law School della Yale University – Senior Judge U.S. Court of Appeals for the Second Circuit

Enrico Al Mureden, Docente di Diritto Civile e di Product Safety, Product Liability and Automotive presso l’Università degli Studi di Bologna

Michele Crisci, Presidente Volvo Car Italia

Moderatore:

Gian Luca Pellegrini, Direttore di Quattroruote